SEG集團(tuán)受邀到廣州大學(xué)舉辦“酒店管理知多少”公開課,賦能未來酒店精英

瑞士酒店管理教育集團(tuán)(SEG)旗下院校的代表團(tuán),受邀前往廣州大學(xué),成功舉辦了一場主題為“酒店管理知多少”的行業(yè)公開課。此次活動(dòng)旨在為在校學(xué)子們提供一個(gè)深入了解全球酒店管理行業(yè)前沿趨勢、專業(yè)知識體系與廣闊職業(yè)前景的窗口,搭建起學(xué)術(shù)理論與行業(yè)實(shí)踐之間的橋梁。

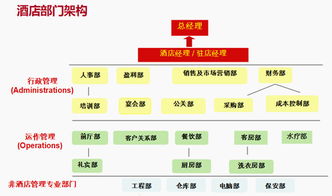

公開課現(xiàn)場氣氛熱烈,座無虛席。SEG的資深講師與行業(yè)專家首先從宏觀視角切入,剖析了全球酒店及泛服務(wù)業(yè)在數(shù)字化、個(gè)性化及可持續(xù)發(fā)展背景下的變革與機(jī)遇。他們指出,現(xiàn)代酒店管理早已超越傳統(tǒng)的客房與餐飲服務(wù)范疇,延伸至奢華旅游、會展策劃、品牌營銷、健康養(yǎng)生及地產(chǎn)開發(fā)等多個(gè)領(lǐng)域,成為一個(gè)充滿活力與創(chuàng)新的綜合性學(xué)科。

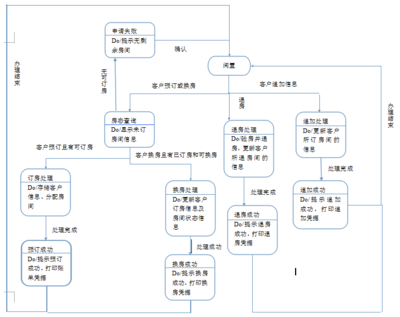

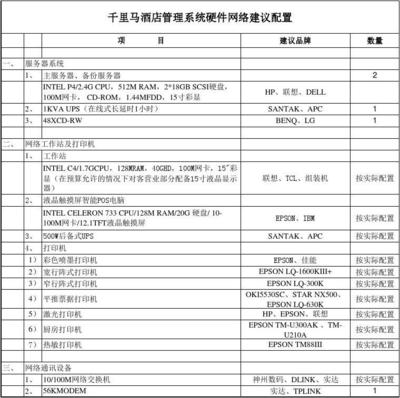

課程聚焦于酒店管理的核心知識與技能。專家們通過生動(dòng)的案例,講解了酒店運(yùn)營管理、收益管理、客戶體驗(yàn)設(shè)計(jì)、奢侈品品牌管理以及創(chuàng)業(yè)學(xué)等關(guān)鍵模塊。他們特別強(qiáng)調(diào)了在全球化背景下,跨文化溝通能力、領(lǐng)導(dǎo)力、數(shù)字素養(yǎng)和企業(yè)家精神對于未來行業(yè)領(lǐng)袖的重要性。SEG獨(dú)特的“理論+實(shí)踐”教學(xué)模式——即在校學(xué)習(xí)與全球帶薪實(shí)習(xí)相結(jié)合——也被重點(diǎn)介紹,這種模式確保了學(xué)生能夠?qū)W以致用,畢業(yè)即具備強(qiáng)大的職場競爭力。

在互動(dòng)環(huán)節(jié),同學(xué)們踴躍提問,問題涵蓋了課程選擇、實(shí)習(xí)機(jī)會、職業(yè)生涯規(guī)劃以及海外求學(xué)體驗(yàn)等多個(gè)方面。SEG的老師們結(jié)合自身豐富的行業(yè)與教育經(jīng)驗(yàn),給予了細(xì)致而專業(yè)的解答,并鼓勵(lì)同學(xué)們保持對服務(wù)業(yè)的熱忱,積極拓寬國際視野。

此次“酒店管理知多少”公開課走進(jìn)廣州大學(xué),不僅為學(xué)子們揭開了酒店管理專業(yè)的神秘面紗,激發(fā)了他們對這一領(lǐng)域的興趣,也進(jìn)一步鞏固了SEG與中國頂尖高校之間的交流與合作。SEG作為瑞士酒店管理教育的代表,始終致力于培養(yǎng)具有國際競爭力、戰(zhàn)略思維和服務(wù)精神的行業(yè)未來之星。本次活動(dòng)再次印證了其將最前沿的行業(yè)洞察與教育理念帶入中國校園的承諾,為有意投身于充滿魅力的酒店與泛服務(wù)行業(yè)的中國學(xué)子,點(diǎn)亮了一盞指引明燈。

如若轉(zhuǎn)載,請注明出處:http://www.yyscsmc.cn/product/57.html

更新時(shí)間:2026-05-09 03:34:04